逻辑斯蒂回归与Softmax回归的极大似然估计

0. 说明

- 使用极大似然估计(i.i.d independent and identically distributed)

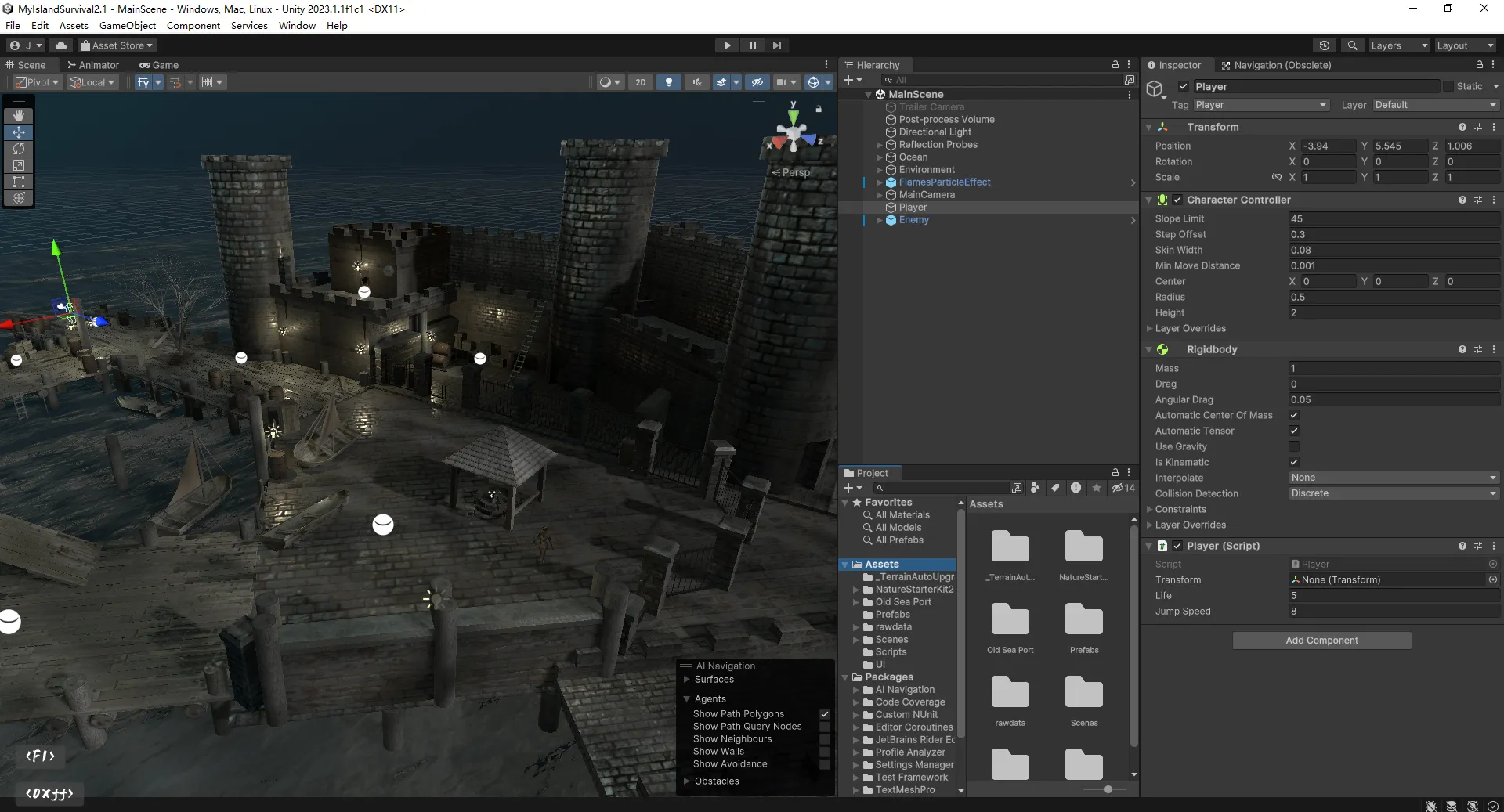

- 推导逻辑斯蒂回归和Softmax回归用于分类问题的目标函数

1. 逻辑斯蒂回归的极大似然估计

线性回归的任务是预测,单也可用来分类

伯努利分布

| $y_n$ | 1 | 0 |

| :—-: | :———————-: | :———————-: |

| $p_n$ | $p^1(x_n;\omega)$ | $p^2(x_n;\omega)$ |

其中

- 极大似然估计(i.i.d)

- 目标函数

2. Softmax回归的极大似然估计

多类分类

概率分布列

| $y_n$ | 1 | 2 | $\cdots$ | C |

| :—-: | :————————-: | :————————-: | :———: | :————————-: |

| $p_n$ | $p^1(x_n;\omega_1)$ | $p^2(x_n;\omega_2)$ | $\cdots$ | $p^C(x_n;\omega_C)$ |

其中

- 极大似然估计(i.i.d)

- 目标函数令则有目标函数化简为

- 交叉熵损失函数(Cross Entropy Loss)

在目标函数的基础上乘以$\frac{1}{N}$

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Jermain Liu!

评论

ValineLivere